Deepfake: Wahn oder Wirklichkeit? Wie KI unser Vertrauen missbraucht

Veröffentlicht am: 24 Feb. 2024

Zuletzt geändert am: 27 Nov. 2025

Was ist ein Deepfake und wie funktioniert er?

A deepfake ist eine ausgeklügelte digitale Manipulation, die „Deep Learning“ und „Fake“ kombiniert. Mithilfe von künstlicher Intelligenz (KI) verändern Deepfakes Bilder, Videos und Audiodateien, um Inhalte zu erstellen, die echt aussehen und klingen - es aber nicht sind. Aber warum werden Deepfakes erstellt und wie funktioniert diese Technologie eigentlich?

Deepfakes basieren auf neuronalen Netzwerken, KI-Systemen, die dem menschlichen Gehirn nachempfunden sind. Wenn sie mit großen Datensätzen von Bildern, Videos oder Audiodaten trainiert werden, lernen diese Netzwerke Muster und erzeugen äußerst realistische Manipulationen. Eines der leistungsfähigsten neuronalen Netzwerke ist das Generative Adversarial Network (GAN).

Ein GAN besteht aus zwei Algorithmen: Einer erstellt die Fälschung (der Fälscher) und der andere versucht, sie zu erkennen (der Ermittler). Durch kontinuierliche Iterationen verbessert sich der Fälscher und macht den Inhalt immer realistischer - ein Prozess, der als Deep Learning bezeichnet wird.

Verschiedene Arten von Deepfakes

Deepfakes gibt es in verschiedenen Formen:

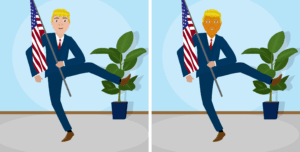

- Face-Swapping: Das Ersetzen des Gesichts einer Person durch ein anderes in Bildern oder Videos, was oft zur Unterhaltung oder zur Nachahmung verwendet wird.

- Stimmenvertauschung: Manipulation von Audio, um die Stimme einer anderen Person zu imitieren. Fortgeschrittene Versionen synchronisieren Lippen- und Gesichtsbewegungen für mehr Realismus.

- Körperpuppenspiel: Das Erfassen und Nachahmen von Körperbewegungen in Echtzeit, um die Gesten oder Handlungen einer Person zu imitieren.

Warum sind Deepfakes so gefährlich?

Deepfakes können ernsthafte Risiken bergen. Die Zahl der Deepfake-Dateien, die erstmals 2017 zur Erstellung von Inhalten für Erwachsene - vor allem für Frauen - genutzt wurden, ist seitdem sprunghaft angestiegen. Von 500.000 im Jahr 2023 auf schätzungsweise 8 Millionen im Jahr 2025 stellen diese KI-manipulierten Mediendateien eine noch nie dagewesene Bedrohung für Unternehmen und Privatpersonen dar, so dass die Erkennung und Eindämmung wichtiger denn je ist.

Während die KI Fortschritte macht, besteht die Herausforderung nicht nur in der Technologie, sondern auch im Mangel an Erkennungsinstrumenten. Selbst bei Wettbewerben mit riesigen Datensätzen und mehreren Algorithmen ist es schwierig, Deepfakes mit einer Erfolgsquote von mehr als 65 % zu erkennen. Dies macht ein Bewusstsein für Cybersicherheit und eine proaktive Überwachung unerlässlich.

Beispiele für Deepfake-Missbrauch in der realen Welt

Deepfakes haben weltweit spürbare Folgen:

- Gabun, 2018: Ein manipuliertes Video von Präsident Ali Bongo löste politische Unruhen und einen Putschversuch aus.

- Der Fall Emma González: Gegner haben das Video der Rede einer Überlebenden verändert, um ihre Botschaft falsch darzustellen.

- Nancy Pelosi: Ein Video wurde so bearbeitet, dass die Sprecherin verwirrt wirkte und Millionen von Aufrufen erhielt, obwohl es falsch war.

- Rana Ayyub: Eine Journalistin wurde mit einem gefälschten pornografischen Video angegriffen, um ihre Glaubwürdigkeit zu beschädigen.

Beliebte Tools zur Erstellung von Deepfakes

- DeepFaceLab: Die am weitesten verbreitete Open-Source-Software für Face-Swapping und Gesichtsmanipulation (Windows & Linux).

- Zao: Chinesische Smartphone-App für sofortige Deepfake-Videos, hauptsächlich zur Unterhaltung (Android & iOS, nur China).

- GesichtsApp: Ändert Alter, Geschlecht oder fügt Merkmale wie Tattoos oder Make-up hinzu (Android & iOS). Die Benutzer müssen der Freigabe der Bildrechte zustimmen.

- Avatarify: Erzeugt live Deepfakes für Videoanrufe, die Gesichtsbewegungen in Echtzeit imitieren (Windows, Mac, Linux, iOS).

Wie man einen Deepfake erkennt

Die Identifizierung von Deepfakes kann schwierig sein. Prüfen Sie den Kontext sorgfältig und achten Sie auf häufige Anzeichen, die das FBI hervorhebt:

- Visuelle Verzerrungen, Unschärfe oder inkonsistente Beleuchtung

- Unnatürliche Platzierung der Augen oder Asymmetrie des Gesichts

- Ungewöhnliche Kopf- oder Körperbewegungen

- Lippensynchronisationsprobleme zwischen Stimme und Gesichtsbewegungen

- Unscharfe oder undeutliche Hintergründe

- Artefakte in Pupillen oder Ohrläppchen

Positive Anwendungen der Deepfake-Technologie

Nicht alle Deepfakes sind schädlich. In der Unterhaltungsbranche hat die KI den jungen Luke Skywalker in The Mandalorian nachgebildet, und Disney plant, Disney Megapixel Deepfakes für neue Filme zu verwenden. Im Bildungsbereich erstellt Synthesia KI-gesteuerte E-Learning-Videos mit realistischen Avataren. Forscher haben sogar die Mona Lisa animiert und zeigen damit den kreativen und ethischen Einsatz von Deepfake-KI.

Schutz vor Deepfakes: Cybersecurity-Bewusstsein

Durch die Schulung der Mitarbeiter werden diese in die Lage versetzt, Manipulationen zu erkennen und darauf zu reagieren, wodurch sowohl das Unternehmen als auch die digitale Integrität geschützt werden. Proaktives Training reduziert die Risiken durch bösartige Deepfakes, stärkt die Abwehrkräfte und befähigt Mitarbeiter, als wachsame Hüter der Authentizität zu agieren. Erfahren Sie mehr über den Schutz Ihres Unternehmens vor KI-gesteuerten Bedrohungen mit der Human Risk Management Platform, die automatisiertes Sicherheitsbewusstsein, fortschrittliche Phishing-Simulationen, Risiko-Intelligenz und -Analyse sowie Compliance Management bietet.

FAQ: Deepfakes erklärt

Was ist ein Deepfake?

Ein Deepfake ist ein von KI generiertes Audio-, Bild- oder Videomaterial, das die Realität so manipuliert, dass es den Anschein erweckt, Menschen würden Dinge sagen oder tun, die sie nie getan haben. Es wird mit fortschrittlichen maschinellen Lerntechniken wie neuronalen Netzwerken und GANs erstellt.

Sind Deepfakes illegal?

Das hängt von der Nutzung ab. Unerlaubte Inhalte oder Betrug können strafbar sein, während die Nutzung zu Unterhaltungszwecken legal sein kann.

Wie kann ich einen Deepfake erkennen?

Achten Sie auf visuelle Verzerrungen, unnatürliche Gesichtsbewegungen, Lippensynchronisationsprobleme oder uneinheitliche Hintergründe.

Kann KI immer Deepfakes erkennen?

Nein. Selbst eine fortschrittliche KI hat Schwierigkeiten, hochrealistische Fälschungen konsequent zu erkennen.

Werden Deepfakes nur für negative Zwecke verwendet?

Nein. Sie werden in Filmen, im Marketing, beim E-Learning und bei kreativen Projekten auf ethische Weise verwendet.

Wie kann ich meine Organisation vor Deepfakes schützen?

Schulen Sie Ihre Mitarbeiter in Sachen Cybersicherheit und implementieren Sie Überwachungstools, um verdächtige Inhalte zu erkennen.