Deepfake : Illusion ou réalité ? Comment l'IA abuse de notre confiance

Publié le: 24 Fév 2024

Dernière modification le: 27 Nov 2025

Qu’est-ce qu’un Deepfake et comment fonctionne-t-il ?

A Le deepfake est une manipulation numérique sophistiquée combinant « deep learning » et « fake ». Grâce à l’intelligence artificielle (IA), les deepfakes modifient les images, les vidéos et le son pour créer un contenu qui semble et paraît réel, mais qui ne l’est pas. Mais pourquoi les deepfakes sont-ils créés et comment cette technologie fonctionne-t-elle réellement ?

Les deepfakes s’appuient sur des réseaux neuronaux, des systèmes d’intelligence artificielle inspirés du cerveau humain. Lorsqu’ils sont entraînés à partir de vastes ensembles d’images, de vidéos ou de sons, ces réseaux apprennent des modèles et génèrent des manipulations très réalistes. L’un des réseaux neuronaux les plus puissants est le Generative Adversarial Network (GAN).

Un GAN se compose de deux algorithmes : l’un crée le faux (le faussaire) et l’autre tente de le détecter (l’enquêteur). Grâce à des itérations continues, le faussaire s’améliore, rendant le contenu de plus en plus réaliste - un processus appelé apprentissage profond.

Les différents types de « deepfakes

Les « deepfakes » se présentent sous plusieurs formes :

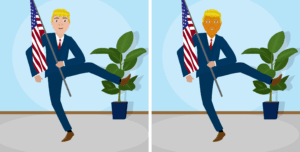

- Échange de visages : Remplacement du visage d’une personne par celui d’une autre dans des images ou des vidéos, souvent utilisé à des fins de divertissement ou d’usurpation d’identité.

- Échange de voix : Manipulation de l’audio pour imiter la voix de quelqu’un. Les versions avancées synchronisent les mouvements des lèvres et du visage pour plus de réalisme.

- Marionnette corporelle : Capturer et reproduire les mouvements du corps en temps réel pour imiter les gestes ou les actions d’une personne.

Pourquoi les « deepfakes » sont-ils dangereux ?

Les deepfakes peuvent présenter de sérieux risques. Initialement exploité en 2017 pour créer du contenu adulte non consensuel - ciblant principalement les femmes - le volume de fichiers deepfake a depuis explosé. Passant de 500 000 en 2023 à environ 8 millions en 2025, ces fichiers multimédias manipulés par l’IA représentent désormais des menaces sans précédent pour les entreprises et les particuliers, ce qui rend la détection et l’atténuation plus critiques que jamais.

À mesure que l’IA progresse, le défi ne réside pas seulement dans la technologie, mais aussi dans le manque d’outils de détection. Même les concours utilisant des ensembles de données massives et de multiples algorithmes peinent à détecter les deepfakes avec un taux de réussite supérieur à 65 %. La sensibilisation à la cybersécurité et la surveillance proactive sont donc essentielles.

Exemples concrets d’utilisation abusive de Deepfake

Les « deepfakes » ont eu des conséquences tangibles dans le monde entier :

- Gabon, 2018 : Une vidéo manipulée du président Ali Bongo a déclenché des troubles politiques et une tentative de coup d’État.

- Affaire Emma González : Les opposants ont modifié la vidéo du discours d’une survivante pour déformer son message.

- Nancy Pelosi : Une vidéo a été éditée pour donner l’impression que la présidente de la Chambre des représentants est confuse, et a été visionnée des millions de fois bien qu’elle soit fausse.

- Rana Ayyub : Une journaliste a été la cible d’une fausse vidéo pornographique destinée à nuire à sa crédibilité.

Outils populaires de création de Deepfake

- DeepFaceLab : Le logiciel open-source le plus utilisé pour l’échange de visages et la manipulation faciale (Windows et Linux).

- Zao : Application chinoise pour smartphone permettant de visionner instantanément de fausses vidéos, principalement à des fins de divertissement (Android et iOS, Chine uniquement).

- FaceApp : Modifie l’âge, le sexe ou ajoute des éléments comme des tatouages ou du maquillage (Android et iOS). Les utilisateurs doivent consentir à ce que les droits d’image soient partagés.

- Avatarify : Crée des deepfakes en direct pour les appels vidéo, en imitant les mouvements du visage en temps réel (Windows, Mac, Linux, iOS).

Comment repérer un Deepfake

Identifier les deepfakes peut s’avérer délicat. Vérifiez soigneusement le contexte et recherchez les signes communs mis en évidence par le FBI :

- Distorsions visuelles, flou ou éclairage incohérent

- Placement non naturel des yeux ou asymétrie du visage

- Mouvements bizarres de la tête ou du corps

- Problèmes de synchronisation entre la voix et les mouvements du visage

- Arrière-plans flous ou indistincts

- Artéfacts dans les pupilles ou les lobes d’oreille

Applications positives de la technologie Deepfake

Les « deepfakes » ne sont pas tous nuisibles. Dans le domaine du divertissement, l’IA a recréé le jeune Luke Skywalker dans The Mandalorian, et Disney prévoit d’utiliser des deepfakes Disney Megapixel pour de nouveaux films. Dans le domaine de l’éducation, Synthesia crée des vidéos d’apprentissage en ligne pilotées par l’IA à l’aide d’avatars réalistes. Des chercheurs ont même animé la Joconde, illustrant ainsi les utilisations créatives et éthiques de l’IA profonde.

Se protéger contre les « deepfakes » : Sensibilisation à la cybersécurité

La formation du personnel lui permet d’acquérir les compétences nécessaires pour détecter les manipulations et y réagir, protégeant ainsi l’organisation et l’intégrité numérique. La formation proactive réduit les risques liés aux deepfakes malveillants, renforce les défenses et permet aux employés d’agir en tant que gardiens vigilants de l’authenticité. Apprenez-en plus sur la protection de votre organisation contre les menaces pilotées par l’IA avec la plateforme de gestion des risques humains, qui comprend la sensibilisation automatisée à la sécurité, des simulations avancées de phishing, l’intelligence et l’analyse des risques et la gestion de la conformité.

FAQ : Les Deepfakes expliqués

Qu'est-ce qu'un deepfake ?

Un deepfake est un fichier audio, image ou vidéo généré par l’IA qui manipule la réalité pour faire croire que des personnes ont dit ou fait des choses qu’elles n’ont jamais faites. Il est créé à l’aide de techniques d’apprentissage automatique avancées telles que les réseaux neuronaux et les GAN.

Les "deepfakes" sont-ils illégaux ?

Cela dépend de l’utilisation. Les contenus non consensuels ou la fraude peuvent être criminels, tandis que les utilisations à des fins de divertissement peuvent être légales.

Comment puis-je détecter un deepfake ?

Recherchez les distorsions visuelles, les mouvements faciaux non naturels, les problèmes de synchronisation labiale ou les arrière-plans incohérents.

L'IA peut-elle toujours détecter les deepfakes ?

Non. Même l’IA la plus avancée a du mal à détecter les deepfakes très réalistes de manière cohérente.

Les deepfakes sont-ils uniquement utilisés à des fins négatives ?

Non. Ils sont utilisés dans les films, le marketing, l’apprentissage en ligne et les projets créatifs dans le respect de l’éthique.

Comment puis-je protéger mon organisation contre les "deepfakes" ?

Formez le personnel à la cybersécurité et mettez en place des outils de surveillance pour détecter les contenus suspects.